Представители Фонда приняли участие в V Всероссийских академических слушаниях на тему: «Уголовное право и безопасность цифрового общества: пределы криминализации деяний, связанных с искусственным интеллектом и дипфейками (о законах, которые будут)». Ключевым предметом обсуждения стал проект федерального закона «Об основах государственного регулирования сфер применения технологий искусственного интеллекта в Российской Федерации», который задает новые ориентиры для развития правовой системы в эпоху цифровизации.

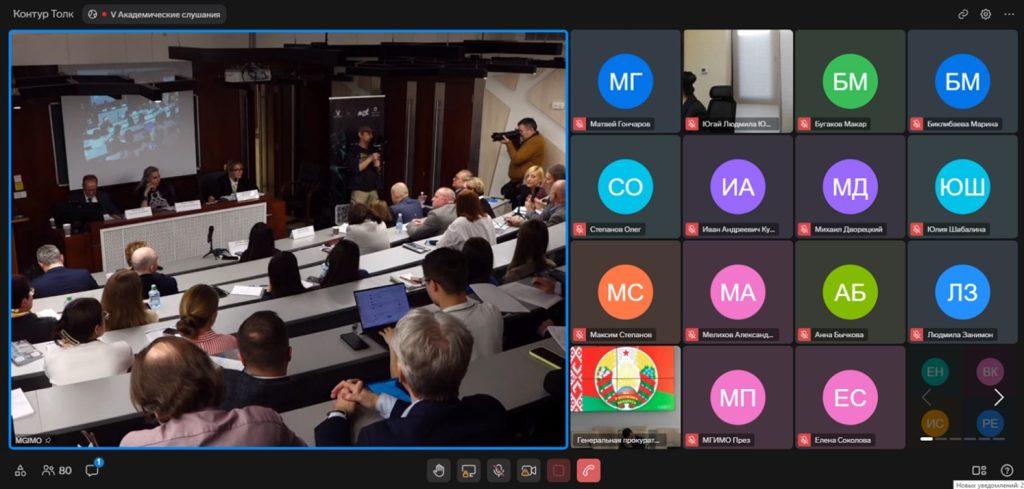

Мероприятие, прошедшее в смешанном формате, собрало представителей законодательной и судебной власти, правоохранительных органов, банковской сферы, ведущих научных школ, IT-индустрии и бизнеса. Организаторами выступили МГИМО МИД России, АНО «Белый Интернет», Совет при Президенте РФ по развитию гражданского общества и правам человека (СПЧ) и АНО «Платформа для работы с обращениями предпринимателей».

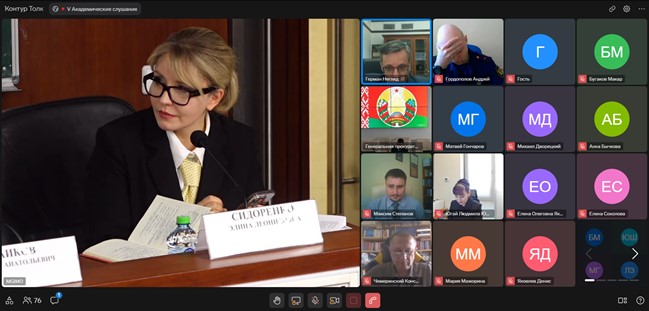

Модератор слушаний, доктор юридических наук, профессор МГИМО, гендиректор АНО «Белый Интернет», член СПЧ Элина Сидоренко обозначила ключевые векторы дискуссии: от необходимости пересмотра традиционных объектов уголовно-правовой охраны до определения границ ответственности разработчиков и пользователей ИИ-систем.

Участники слушаний работали в двух сессиях. Первая была посвящена фундаментальным вопросам уголовной политики: какие модели реагирования на цифровые преступления оптимальны для России, как провести грань между допустимым использованием ИИ и уголовно наказуемым деянием, и насколько действующие статьи УК РФ способны охватить новые вызовы.

Вторая сессия была сфокусирована на прикладных аспектах правоприменения. Спикеры обсудили криминалистические проблемы расследования преступлений с использованием дипфейков, вопросы ответственности участников цифровой экосистемы (от разработчиков до операторов платформ) и необходимость баланса между эффективным преследованием и конституционными гарантиями тайны связи и свободы информации.

Центральным объектом экспертного анализа стал обсуждаемый проект закона об основах регулирования ИИ. Документ, разработанный Правительством РФ, предлагает введение целого ряда новаций, которые вызвали оживленную дискуссию.

Среди ключевых положений, ставших предметом обсуждения:

- институт «доверенных моделей»: статья 8 законопроекта предполагает создание реестра доверенных моделей ИИ, обязательных к применению в госинформсистемах и на объектах КИИ. Эксперты обсудили риски монополизации и необходимость четких критериев включения в реестр;

- маркировка контента: проект обязывает маркировать контент, сгенерированный с помощью ИИ. Участники слушаний отметили важность этой меры для защиты от дипфейков, но подчеркнули сложность ее технической реализации и необходимость разработки универсальных стандартов;

- распределение ответственности: особый интерес вызвала статья 11, устанавливающая ответственность разработчиков и операторов за результат, полученный с помощью ИИ, если они знали или должны были знать о возможности нарушения закона. Дискуссия развернулась вокруг понятия «исчерпывающих мер» для освобождения от ответственности и презумпции добросовестности участников оборота;

- технологический суверенитет: статья 7 вводит понятия «суверенных» и «национальных» моделей ИИ, разработка и обучение которых должны осуществляться на территории РФ силами российских лиц. Эта норма, направленная на обеспечение независимости, вызвала вопросы о балансе между протекционизмом и сохранением инновационной среды.

По итогам слушаний планируется принятие рекомендаций, которые будут направлены в профильные комитеты Государственной Думы, Правительство и правоохранительные органы. Участники сошлись во мнении, что представленный законопроект является важным шагом к формированию комплексного регулирования, однако требует доработки с учетом правоприменительной практики и необходимости защиты прав граждан.

Как отметила модератор Элина Сидоренко: «Мы находимся на этапе формирования законов, которые определят облик цифрового общества на десятилетия вперед. Наша задача – найти ту тонкую грань, где уголовно-правовой запрет будет эффективным, но не станет тормозом для развития технологий. Дискуссия сегодня показала, что научное и экспертное сообщество готово к диалогу с законодателем для достижения этой цели».

Организаторы планируют продолжить серию мероприятий, посвященных правовому регулированию искусственного интеллекта, с учетом поступивших в ходе слушаний предложений и замечаний к тексту законопроекта.

ФПП.